SBT默认的日志级别是Info,我们可以根据自己的需要去设置它的默认日志级别,比如我们在开发过程中,就可以打开Debug日志级别,这样可以看出SBT是如何工作的。SBT的日志级别在sbt.Level类里面定义:

object Level extends Enumeration{

val Debug = Value(1, "debug")

val Info = Value(2, "info")

val Warn = Value(3, "warn")

val Error = Value(4, "error")

/** Defines the label to use for success messages.

* Because the label for levels is defined in this module, the success label is also defined here. */

val SuccessLabel = "success"

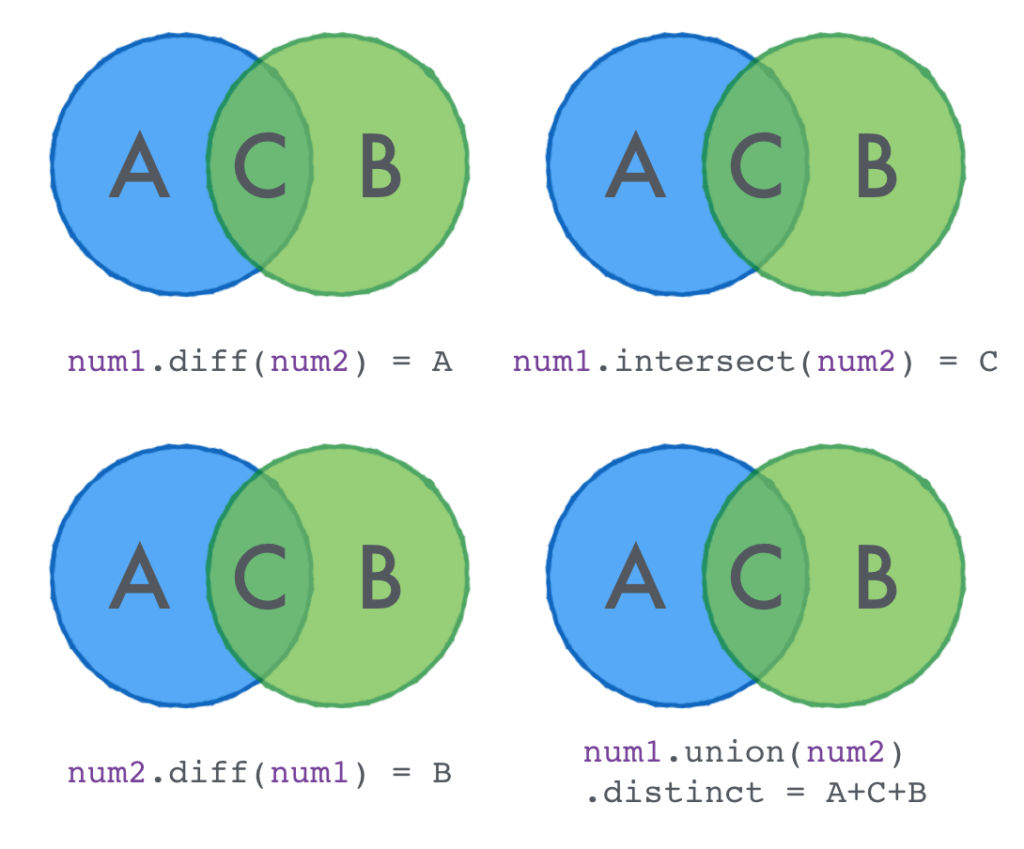

def union(a: Value, b: Value) = if(a.id < b.id) a else b

def unionAll(vs: Seq[Value]) = vs reduceLeft union

/** Returns the level with the given name wrapped in Some, or None if no level exists for that name. */

def apply(s: String) = values.find(s == _.toString)

/** Same as apply, defined for use in pattern matching. */

private[sbt] def unapply(s: String) = apply(s)

}

从上面代码可以看出,Level类其实是一个枚举,主要支持Debug、Info、Warn以及Error四种日志级别。

如果我们创建的是SBT工程,可以设置build.sbt(或者是build.scala)文件,在里面加入

logLevel := Level.Debug

进而修改了SBT的日志级别。

如果使用的是SBT交互式模式,可以在启动SBT之后,运行下面语句即可修改SBT的日志级别:

[iteblog@www.iteblog.com iteblog]$ ./sbt > set logLevel := Level.Warn [info] Defining *:logLevel [info] The new value will be used by *:evicted, *:update [info] Reapplying settings... > package SLF4J: Failed to load class "org.slf4j.impl.StaticLoggerBinder". SLF4J: Defaulting to no-operation (NOP) logger implementation SLF4J: See http://www.slf4j.org/codes.html#StaticLoggerBinder for further details.本博客文章除特别声明,全部都是原创!

原创文章版权归过往记忆大数据(过往记忆)所有,未经许可不得转载。

本文链接: 【设置SBT的日志级别】(https://www.iteblog.com/archives/1556.html)

![Play JSON类库将List[(String, String)]转换成Json字符串](https://www.iteblog.com/wp-content/themes/yusi2.0/img/pic/4.jpg)