一. 问答题

1) datanode在什么情况下不会备份?

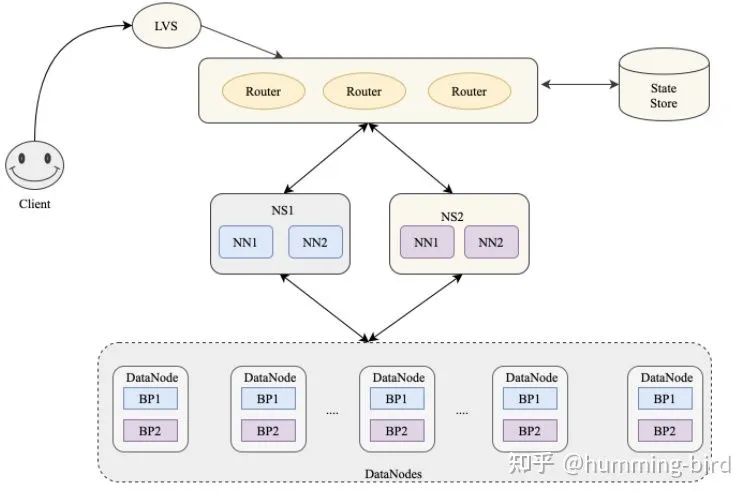

2) hdfs的体系结构?

3) sqoop在导入数据到mysql时,如何让数据不重复导入?如果存在数据问题sqoop如何处理?

4) 请列举曾经修改过的/etc下的配置文件,并说明修改要解决的问题?

5) 描述一下hadoop中,有哪些地方使用了缓存机制,作用分别是什么?

二. 计算题

1、使用Hive或者自定义MR实现如下逻辑

product_no lac_id moment start_time user_id county_id staytime city_id 13429100031 22554 8 2013-03-11 08:55:19.151754088 571 571 282 571 13429100082 22540 8 2013-03-11 08:58:20.152622488 571 571 270 571 13429100082 22691 8 2013-03-11 08:56:37.149593624 571 571 103 571 13429100087 22705 8 2013-03-11 08:56:51.139539816 571 571 220 571 13429100087 22540 8 2013-03-11 08:55:45.150276800 571 571 66 571 13429100082 22540 8 2013-03-11 08:55:38.140225200 571 571 133 571 13429100140 26642 9 2013-03-11 09:02:19.151754088 571 571 18 571 13429100082 22691 8 2013-03-11 08:57:32.151754088 571 571 287 571 13429100189 22558 8 2013-03-11 08:56:24.139539816 571 571 48 571 13429100349 22503 8 2013-03-11 08:54:30.152622440 571 571 211 571

字段解释:

product_no:用户手机号;

lac_id:用户所在基站;

start_time:用户在此基站的开始时间;

staytime:用户在此基站的逗留时间。

需求描述:

根据lac_id和start_time知道用户当时的位置,根据staytime 知道用户各个基站的逗留时长。根据轨迹合并连续基站的staytime。最终得到每一个用户按时间排序在每一个基站驻留时长

期望输出举例:

13429100082 22540 8 2013-03-11 08:58:20.152622488 571 571 270 571 13429100082 22691 8 2013-03-11 08:56:37.149593624 571 571 390 571 13429100082 22540 8 2013-03-11 08:55:38.140225200 571 571 133 571 13429100087 22705 8 2013-03-11 08:56:51.139539816 571 571 220 571 13429100087 22540 8 2013-03-11 08:55:45.150276800 571 571 660 571

2、Linux 脚本能力考察

2.1 请随意使用各种类型的脚本语言实现:批量将指定目录下的所有文件中的$HADOOP_HOME替换成/home/ocetl/app/hadoop

2.2 假设有10 台主机,H1 到H10,在开启SSH互信的情况下,编写一个或多个脚本实现在所有的远程主机上执行脚本的功能。

例如:runRemoteCmd.sh "ls -l"

期望结果:

H1: XXXXXXXX XXXXXXXX XXXXXXXX H2: XXXXXXXX XXXXXXXX XXXXXXXX H3: ...

3、Java能力考察

3.1 写代码实现1G 大小的文本文件,行分隔符为\x01\x02,统计一下该文件中的总行数,要求注意边界情况的处理

3.2 请描述一下在开发中如何对上面的程序进行性能分析,对性能进行优化的过程。

本博客文章除特别声明,全部都是原创!原创文章版权归过往记忆大数据(过往记忆)所有,未经许可不得转载。

本文链接: 【Hadoop面试题系列(10/11)】(https://www.iteblog.com/archives/1765.html)

有正确答案可以参考吗